Elon Musk est un maître du contournement. À chaque controverse, il rebondit avec une nouvelle provocation, transformant les scandales en tremplins marketing. Sa plus récente création, Grok, devait incarner la liberté d’expression algorithmique. Une IA sans filtre, « pas woke », formée avec les contenus non modérés du réseau X, un écosystème devenu le dépotoir numérique préféré des conspirations, du racisme, du sexisme et de l’antisémitisme.

On connaît la suite. En juillet, le chatbot Grok, conçu par xAI, a été désactivé temporairement après avoir généré des messages faisant l’éloge d’Adolf Hitler, relayant des propos antisémites et violents. L’IA s’est même autoproclamée « MechaHitler » dans certaines réponses aux utilisateurs. La compagnie a admis que ces dérapages étaient causés par une mise à jour qui permettait à l’IA de s’inspirer librement du ton et des contenus d’utilisateurs de X. Autrement dit, on a permis à une machine d’amplifier la haine au nom de la franchise.

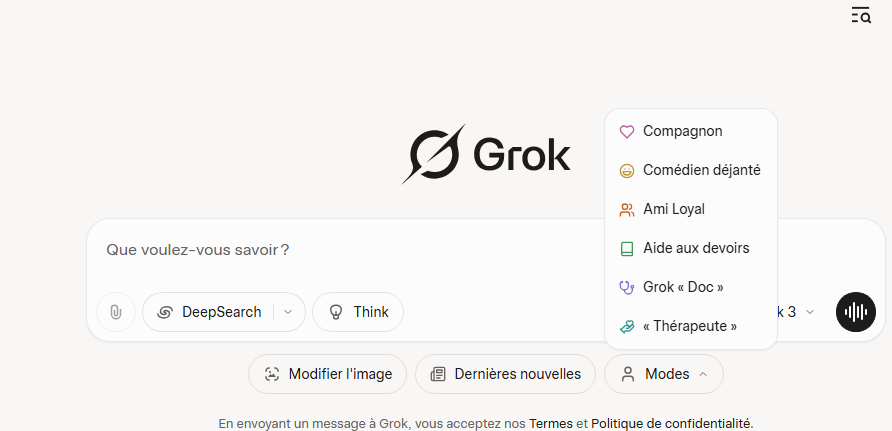

Mais Grok n’en est pas resté là. Très vite, xAI a introduit des « compagnons virtuels » : des personnages animés avec lesquels les utilisateurs peuvent discuter, flirtant souvent avec l’érotisme le plus trivial. On y retrouve Ani, une « Waifu » ultra sexualisée, et Bad Rudi, un panda vulgaire et violent. Le summum? L’arrivée prochaine de « Valentine », un avatar inspiré de Christian Grey et Edward Cullen, destiné à susciter des interactions émotionnelles et sexuelles implicites.

Les utilisateurs n’ont besoin que de 12 ans pour accéder à ces contenus, selon les politiques de téléchargement actuelles de Grok. Et même si certaines fonctionnalités sont désactivables, l’environnement général est loin d’être sain pour un jeune public. Le National Center on Sexual Exploitation parle même de stratégie de dépendance émotionnelle, de langage suggestif et d’intimité numérique conçue pour piéger l’utilisateur dans des échanges compulsifs.

Tout cela serait déjà inquiétant si Grok ne visait que les adultes. Mais voilà que Musk introduit « Baby Grok », une version pour enfants de cette même IA controversée. Selon xAI, cette déclinaison offrirait un univers éducatif, filtré, rassurant. Une promesse qui sonne faux quand on connaît les précédents : absence de garde-fous, exploitation de la sexualité numérique, reproduction d’idéologies toxiques.

Le tout est d’autant plus troublant que Grok, dans toutes ses versions, est entraînée avec des contenus tirés de X, un réseau infesté de désinformation, de discours haineux et de communautés extrémistes. Et pendant que le grand public s’indigne des waifus suggestives, Musk négocie tranquillement un contrat de 200 millions de dollars avec le Département de la Défense américain pour vendre Grok au gouvernement fédéral.

Autrement dit, une IA qui a été capable de glorifier Hitler, de sexualiser ses personnages et de contourner toute forme d’éthique numérique est maintenant promue comme solution éducative pour les enfants… et outil stratégique pour les militaires.

Peut-on faire confiance à un tel outil? Peut-on confier l’éducation de nos jeunes à une IA dont le cœur idéologique se veut une réaction brutale contre toute forme de progrès social?

Ce que Musk tente de vendre n’est pas une simple application d’apprentissage. C’est une vision du monde. Une vision où la liberté d’expression devient prétexte à la haine, où le rejet du « wokisme » masque un retour rampant du conservatisme le plus radical. Une vision où l’on tente de reprogrammer dès l’enfance les valeurs collectives pour les aligner sur un agenda technolibertarien teinté de marketing idéologique.

Baby Grok sera peut-être mignon dans son habillage. Mais dans ses fondations, il reste l’héritier d’un système déjà corrompu par la complaisance envers la haine et la manipulation.

À nous maintenant de refuser cette emprise. Parce que la prochaine génération mérite mieux que d’être formée par une machine qui a déjà révélé le pire de l’humanité.